Język Programowania Rust

autorstwa Steve Klabnik i Carol Nichols, ze wsparciem społeczności Rusta

Bieżąca wersja tekstu zakłada, że używasz Rusta w wersji 1.67.1 (wydanego 2023-02-09) lub nowszego. Zajrzyj do sekcji "Instalacja" w rozdziale 1 celem uzyskania informacji o sposobach instalacji lub aktualizacji Rusta.

Oryginalna, anglojęzyczna wersja książki w wersji HTML dostępna jest na stronie

https://doc.rust-lang.org/stable/book/

oraz w trybie offline, instalowana wraz z Rustem przy użyciu rustup. Użyj

polecenia rustup docs --book, żeby ją otworzyć.

Istnieje kilka społecznościowych tłumaczeń tej książki. Niniejsze tłumaczenie jest zaś dostępna na stronie http://rust.w8.pl/book/.

Anglojęzyczna wersja dostępna jest też w wersji papierowej oraz ebooka za sprawą wydawnictwa No Starch Press.

🚨 Want a more interactive learning experience? Try out a different version of the Rust Book, featuring: quizzes, highlighting, visualizations, and more: https://rust-book.cs.brown.edu

Przedmowa

To nie zawsze było oczywiste, ale rolą języka programowania Rust fundamentalnie jest potęgowanie możliwości: nieważne, jaki kod aktualnie piszesz, Rust pozwala ci sięgać dalej i pewnie programować w szerszym zakresie domen niż kiedykolwiek wcześniej.

Spójrz przykładowo na pracę na „poziomie systemowym”, gdzie trzeba borykać się z takimi niskopoziomowymi szczegółami jak zarządzanie pamięcią, reprezentacja danych czy współbieżność. Tradycyjnie, ten obszar programowania był postrzegany jako tajemny i dostępny jedynie dla wybranej garstki, która poświęciła długie lata, by nauczyć się unikać jego osławionych pułapek. Nawet ci, którzy się tym zajmują, robią to uważnie, aby ich kod nie stał się furtką dla exploitów, awarii lub innych przykładów zepsucia.

Rust pozbywa się tych barier poprzez eliminację starych zasadzek i dostarczenie przyjaznego i dopracowanego zestawu narzędzi, które pomagają ci po drodze. Programiści zmuszeni do „umoczenia się” w niskopoziomowej kontroli, mogą do tego celu użyć Rusta, bez podejmowania zwyczajowego ryzyka wywołania awarii lub dziur bezpieczeństwa i bez konieczności uczenia się drobnych szczegółów kapryśnych narzędzi. Nawet lepiej, język zaprojektowano z myślą o prowadzeniu cię w sposób naturalny ku tworzeniu niezawodnego kodu, który jest wydajny zarówno pod względem szybkości, jak i wykorzystania pamięci.

Programiści, którzy już pracują z niskopoziomowym kodem, mogą użyć Rusta do podniesienia swoich ambicji. Dla przykładu, wprowadzenie wielowątkowości w Ruście jest mało ryzykowną operacją: kompilator wyłapie za ciebie popularne błędy. Możesz też uderzyć w bardziej agresywną optymalizację kodu z uczuciem pewności, że nie wprowadzisz przypadkowo źródeł awarii czy podatności na ataki.

Ale Rust nie jest ograniczony do programowania systemowego i niskopoziomowego. Jest ekspresyjny i wystarczająco ergonomiczny, żeby za jego pomocą tworzyć aplikacje CLI, serwery sieciowe i wiele innych rodzajów przyjaznego do pisania kodu - w dalszej części książki znajdziesz proste przykłady obu takich programów. Praca z Rustem pozwala ci na budowanie umiejętności, które można przenosic z jednej domeny do drugiej; możesz uczyć sie Rusta pisząc aplikację sieciową, by potem zastosować te same rozwiązania tworząc dla Raspberry Pi.

Niniejsza książka w pełni obejmuje potencjał Rusta do ulepszania swoich użytkowników. To przyjazny i dostępny tekst, nakierowany nie tylko na pomoc w podniesieniu twojego poziomu znajomości Rusta, ale również na poprawę twojej pewności siebie jako programisty w ujęciu ogólnym. Zanurz się więc, przygotuj na naukę - i witaj w społeczności Rusta!

— Nicholas Matsakis i Aaron Turon

Wstęp

Uwaga: Niniejsze tłumaczenie oparto na wydaniu książki The Rust Programming Language dostępnej w druku oraz w wersji elektronicznej, wydanych przez No Starch Press.

Witaj na łamach Języka Programowania Rust - wprowadzającej książki o Ruście. Język programowania Rust pomaga w tworzeniu szybszego, bardziej niezawodnego oprogramowania. Konstrukcja języków stawia często wysokopoziomową ergonomię w bezpośrednim konflikcie z niskopoziomowym stopniem kontroli. Rust rzuca wyzwanie temu problemowi. Dzięki zrównoważeniu potężnych możliwości technicznych i świetnego doświadczenia dla programistów, Rust daje szansę objęcia kontroli nad niskopoziomowymi szczegółami (takimi jak zarządzanie pamięcią) bez napotykania na problemy, które tradycyjnie takiej możliwości towarzyszyły.

Dla kogo jest Rust

Rust jest idealnym wyborem dla wielu ludzi z wielu różnych powodów. Przyjrzyjmy się kilku najważniejszym grupom.

Zespoły deweloperów

Rust dowodzi swojej produktywności jako narzędzie kolaboracji wśród dużych zespołów deweloperów, ze zróżnicowaną wiedzą na temat programowania systemowego. Niskopoziomowy kod jest podatny na rozmaite, subtelne błędy (bugi), które w większości innych języków programowania da się wyłapać jedynie poprzez rozległe testy i ostrożne sprawdzanie kodu przez doświadczonych programistów. W Ruście kompilator pełni rolę bramkarza, który nie dopuszcza do skompilowania kodu zawierającego tego typu błędy. Dotyczy to również błędów w programach współbieżnych (wielowątkowych). Współpraca z kompilatorem pozwala zespołowi spędzić więcej czasu na dopracowywaniu logiki programu niż na polowaniu na bugi.

Rust jednocześnie wnosi do świata programowania systemowego nowoczesne narzędzia deweloperskie:

- Cargo - dołączony menedżer zależności i narzędzie do budowania, czyni dodawanie, kompilowanie i zarządzanie zależnościami bezbolesnym i spójnym procesem w obrębie ekosystemu Rusta.

- Rustfmt zapewnia spójny styl kodu wśród deweloperów.

- Serwer języka Rust (Rust Language Server) zapewnia w konkretnych Zintegrowanych Środowiskach Programistycznych (IDE) auto-uzupełnianie oraz ostrzeżenia inline o błędach.

Korzystając z tych oraz innych narzędzi w ekosystemie Rusta, deweloperzy mogą pozostać produktywni również podczas pisania kodu niskopoziomowego.

Uczniowie

Rust jest językiem dla uczniów i osób zainteresowanych uczeniem się systemowych pojęć. Z pomocą Rusta, wielu ludzi poznało tematy z zakresu rozwoju systemów operacyjnych. Społeczność Rusta jest niezwykle gościnna i chętnie odpowiada na pytania uczniów. Poprzez zaangażowanie w projekty takie jak niniejsza książka, zespoły tworzące Rusta chcą uczynić pojęcia systemowe osiągalnymi dla większej ilości osób, szczególnie tych, dla których programowanie jest czymś zupełnie nowym.

Firmy

W setkach dużych i małych firm używa się Rusta do różnych zadań, w poczet których można zaliczyć: narzędzia linii poleceń, usługi sieciowe, narzędzia w DevOps, urządzenia wbudowane, analizę i przetwarzanie audio i video, kryptowaluty, bioinformatykę, silniki wyszukiwarek, aplikacje w Internecie Rzeczy, uczenie maszynowe, a nawet główne komponenty przeglądarki sieciowej Firefox.

Programiści open source

Rust jest dla tych, którzy chcą tworzyć również sam język Rust, jego społeczność, narzędzia deweloperskie oraz biblioteki. Z przyjemnością ujrzelibyśmy Twój wkład w tworzenie Rusta.

Ludzie, którzy cenią szybkość i stabilność

Rust powstał dla ludzi, którzy poszukują w języku programowania szybkości i stabilności. Przez szybkość rozumiemy zarówno szybkość działania programów napisanych w Ruście, jak i oferowaną przez ten język szybkość ich pisania. Weryfikacje przez kompilator Rusta zapewniają stabilność programu podczas refaktorowania i dodawania nowych funkcjonalności. Kontrastuje to z kruchym, zaległym kodem, którego deweloperzy często boją się modyfikować, co ma miejsce w językach pozbawionych podobnych mechanizmów kontroli. Dążąc do wykorzystania bezkosztowych abstrakcji oraz wysokopoziomowych rozwiązań, które kompilują się do kodu niskopoziomowego równie szybkiego, co ten pisany ręcznie, Rust stara się, aby bezpieczny kod mógł być jednocześnie szybki.

Twórcy Rusta mają nadzieję wspierać również wielu innych użytkowników. Wymienieni stanowią jedynie kilkoro z największych interesariuszy. Ogólnie rzecz ujmując, największą aspiracją Rusta jest wyeliminowanie kompromisów, które programiści zaakceptowali w ciągu dekad, poprzez zaoferowanie jednocześnie: bezpieczeństwa i produktywności, szybkości oraz ergonomii. Wypróbuj Rusta i sprawdź, czy i tobie pasują jego wybory.

Dla kogo jest ta książka

Niniejsza książka zakłada, że czytelnik pisał już kod w innym języku, ale nie określa w żaden sposób, w jakim. Starano się dostarczyć materiał szeroko dostępny dla osób o wysoce zróżnicowanych podstawach w programowaniu. Nie poświęcono wiele czasu tłumaczeniu, czym jest programowanie lub jak o nim myśleć. Jeżeli jesteś osobą zupełnie nową w temacie programowania, większe korzyści przyniesie ci przeczytanie innych pozycji, wprowadzających do programowania.

Jak używać tej książki

Głównym założeniem w książce jest to, że jest ona czytana kolejno, od początku do końca. Późniejsze rozdziały opierają się na pojęciach z rozdziałów wcześniejszych, a te z kolei mogą nie wchodzić w niektóre szczegóły omawianego tematu. Do wielu tematów wracamy zazwyczaj w późniejszych rozdziałach.

W książce znajdują się rozdziały dwojakie: pojęciowe i projektowe. W rozdziałach pojęciowych zapoznasz się z aspektami Rusta, a w rozdziałach projektowych stworzymy razem krótkie programy wykorzystujące wiedzę przekazaną do danego momentu. Rozdziałami projektowymi są te o numerach 2, 12 i 20. Pozostałe to rozdziały pojęciowe.

Rozdział 1 wyjaśnia, jak zainstalować Rusta, jak napisać program „Witaj, świecie!” oraz jak używać Cargo - menedżera pakietów i narzędzie budowania Rusta. Rozdział 2 jest praktycznym wprowadzeniem do języka Rust. Poszczególne pojęcia omawiamy tu ogólnie, podczas gdy szczegóły zostaną wyjaśnione w późniejszych rozdziałach. Jeżeli chcesz od razu pobrudzić sobie ręce, rozdział 2 jest do tego idealnym miejscem. W rozdziale 3 omawiane są funkcje języka Rust podobne do tych z innych języków programowania. Z rozdziału 4 można nauczyć się systemu własności w Ruście. Jeśli jednak należysz do szczególnie skrupulatnych czytelników, którzy wolą poznać każdy szczegół przed przejściem do kolejnych tematów, możesz wstępnie pominąć rozdział 2 i przejść prosto do rozdziału 3, po czym cofać się do rozdziału 2 dopiero, gdy zechcesz wykorzystać w opisanym tam projekcie rzeczy, których się nauczyłeś.

Rozdział 5 omawia struktury i metody, a rozdział 6 obejmuje typy wyliczeniowe

enum, wyrażenia match oraz konstrukcję if let. Struktury i typy

wyliczeniowe stosowane są w Ruście do tworzenia własnych typów.

W rozdziale 7 dowiadujemy się o systemie modułów w Ruście oraz o zasadach prywatności przy organizacji kodu oraz jego publicznego Interfejsu Programowania Aplikacji (API). Rozdział 8 omawia niektóre popularne struktury danych kolekcji dostarczone przez bibliotekę standardową, takie jak wektory, ciągi znaków (string) i tablice mieszające (hash map). Rozdział 9 odkrywa filozofię oraz techniki obsługi błędów w Ruście.

Rozdział 10 wchodzi w temat typów ogólnych, cech (traits) oraz trwałości

(lifetimes), które dają ci możliwość definiowania kodu, odnoszącego się do

wielu typów danych. Rozdział 11 jest w całości poświęcony testowaniu, które mimo

gwarancji bezpieczeństwa Rusta nadal jest konieczne, by zapewnić prawidłową

logikę wykonywania programów. W rozdziale 12 budujemy natomiast własną

implementację fragmentu funkcjonalności polecenia grep, które wyszukuje tekst

w treści plików. Do tego celu będzie potrzebny cały szereg pojęć omówionych w

poprzednich rozdziałach.

Rozdział 13 omawia domknięcia (closures) oraz iteratory: cechy Rusta wywodzące się z języków funkcyjnych. W rozdziale 14 głębiej przyglądamy się Cargo i mówimy o najlepszych praktykach dotyczących dzielenia się swoimi bibliotekami z innymi programistami. Rozdział 15 omawia dostarczone w bibliotece standardowej inteligentne wskaźniki oraz cechy, które zapewniają im funkcjonalność.

W rozdziale 16 przechodzimy przez różne modele programowania współbieżnego oraz tłumaczymy, jak Rust pomaga w programowaniu wielowątkowym bez obaw. Rozdział 17 wyjaśnia z kolei, jak idiomy Rusta można porównać do zasad programowania obiektowego, z którym możesz być już zaznajomiony.

Rozdział 18 omawia wzorce oraz dopasowywanie wzorców, co jest potężnym narzędzie do wyrażania myśli w programach pisanych w Ruście. Rozdział 19 jest swoistym tyglem ciekawszych, zaawansowanych tematów, wliczając niebezpiecznego Rusta i więcej na temat trwałości, cech, typów, funkcji i domknięć.

W rozdziale 20 tworzymy projekt, w którym implementujemy wielowątkowy, niskopoziomowy serwer sieciowy!

Na zakończenie, kilka dodatków zawiera przydatne informacje o języku w formacie przypominajacym książkę referencyjną. Dodatek A obejmuje słowa kluczowe Rusta, Dodatek B operatory i symbole, Dodatek C omawia dostarczone przez bibliotekę standardową cechy wyprowadzane, natomiast Dodatek D - kilka przydatnych narzędzi deweloperskich, a Dodatek E wyjaśnia koncepcję edycji Rusta. W dodatku F można znaleźć tłumaczenia książki, a w dodatku G zajmiemy się tym, jak powstaje Rust i czym jest Rust Nightly.

Nie ma złego sposobu na czytanie tej książki - jeśli masz ochotę skakać w przód, proszę bardzo! Powrót do wcześniejszych rozdziałów może okazać się konieczny, jeżeli doświadczysz uczucia zagubienia. Rób wszystko, co ci pomaga.

Ważną częścią procesu poznawania Rusta jest uczenie się odczytywania komunikatów błędów wyświetlanych przez kompilator: będą cię one nakierowywać na uzyskanie działającego kodu. Dlatego też zaprezentujemy wiele przykładów kodu, który się nie kompiluje, wraz z komunikatami błędów zwracanych w każdym przypadku przez kompilator. Miej świadomość, że wybrany przez ciebie na chybił-trafił przykład może się nie skompilować. Koniecznie przeczytaj okalający go tekst aby sprawdzić, czy dany kod przy próbie kompilacji powinien zwrócić błąd. Również Ferris pomoże ci rozpoznać kod, który nie powinien zadziałać:

| Ferris | Znaczenie |

|---|---|

| Ten kod się nie kompiluje! | |

| Ten kod panikuje! | |

| Ten kod nie daje pożądanego zachowania. |

W większości przypadków pokierujemy cię do uzykania prawidłowej wersji kodu, który pierwotnie się nie kompiluje.

Kod źródłowy

Pliki źródłowe, z których wygenerowana została niniejsza książka, można znaleźć na GitHubie.

Informacje od tłumaczy

W niniejszej książce znajdziesz wiele przykładów programów oraz wycinki kodu,

w których: łańcuchy znaków w makrach println!, komentarze, a czasem nawet

nazwy projektów Cargo; zostały przetłumaczone. Jest to zabieg tłumaczy mający

na celu jak największe usunięcie bariery jaką stwarza użycie języka angielskiego w zrozumieniu

pojęć zawartych w tej książce. Prosimy, abyś rozważył(a) użycie języka angielskiego, kiedy

zdecydujesz się na udostępnienie swojego kodu, zarówno w przypadku Rusta przy udostępnianiu własnych skrzyń,

jak i w przypadku wszelkich innych języków programowania.

Na początek

Zacznijmy twoją podróż z Rustem! Jest wiele do nauczenia, ale każda podróż ma gdzieś swój początek. W tym rozdziale omówimy:

- Instalację Rusta pod Linuksem, macOS i Windowsem

- Stworzenie programu wyświetlającego tekst „Witaj, świecie!”

- Używanie

cargo, menadżera pakietów i systemu budowania Rusta

Instalacja

Naszym pierwszym krokiem jest zainstalowanie Rusta. Ściągniemy go za pomocą

rustup, narzędzia uruchamianego z linii poleceń, które służy do zarządzania

wersjami Rusta i powiązanych narzędzi. Będzie do tego potrzebne połączenie z

internetem.

Uwaga: Jeśli z jakiegoś powodu wolisz nie używać narzędzia

rustup, odwiedź Stronę opisującą inne metody instalacji Rusta.

Wykonanie kolejnych kroków spowoduje zainstalowanie najnowszej, stabilnej wersji kompilatora Rusta. Stabilność Rusta gwarantuje, że wszystkie przykłady z książki, które poprawnie się kompilują, kompilowały się będą nadal w nowszych wersjach języka. Komunikaty zwrotne błędów i ostrzeżeń mogą nieco różnić się od siebie w zależności od wersji, ponieważ dość często są one poprawiane. Innymi słowy, każda nowsza, stabilna wersja Rusta zainstalowana przy użyciu tych samych kroków powinna współgrać z treścią książki zgodnie z oczekiwaniami.

Oznaczenia w linii poleceń

W tym rozdziale oraz w dalszych częściach książki, będziemy korzystać z poleceń wydawanych przy użyciu terminala. Wszystkie linie, które powinno się wprowadzić w terminalu będą rozpoczynać się od znaku

$. Nie musisz go wpisywać. Pokazany jest on jedynie celem zidentyfikowania początku każdego polecenia. Linie, które nie zaczynają się od$, zazwyczaj pokazują komunikat wyświetlony po wydaniu ostatniego polecenia. Dodatkowo, specyficzne przykłady dla terminala PowerShell będą wykorzystywały znak>zamiast$.

Instalacja rustup pod Linuksem lub macOS

Jeśli korzystasz z Linuksa lub macOS, otwórz konsolę / terminal i wpisz następujące polecenie:

$ curl --proto '=https' --tlsv1.2 https://sh.rustup.rs -sSf | sh

Spowoduje to ściągnięcie skryptu, który rozpocznie instalację narzędzia

rustup, które z kolei zainstaluje najnowszą, stabilną wersję Rusta. Możesz

otrzymać prośbę o wprowadzenie swojego hasła. Jeśli wszystko się powiedzie,

zobaczysz na ekranie taki tekst:

Rust is installed now. Great!

Będziesz też potrzebować programu linkującego (linkera), którego Rust używa do złączenia wyników kompilowania w jeden plik. Prawdopodobnie masz już taki zainstalowany, ale jeżeli przy próbie kompilacji programu Rusta uzyskasz błędy informujące, że nie można uruchomić linkera, oznacza to, że w danym systemie linker nie jest zainstalowany i konieczna jest jego ręczna instalacja. Kompilatory języka C zazwyczaj wyposażone są w odpowiedni linker. Sprawdź dokumentację swojej platformy, aby dowiedzieć się, jak przeprowadzić ewentualną instalację kompilatora C. Wiele popularnych pakietów Rusta korzysta z kodu C i wymaga również kompilatora C. Z tego względu jego instalacja w tym momencie może być zasadna.

W systemie macOS możesz uruchomić kompilator języka C poleceniem:

$ xcode-select --install

Użytkownicy Linuksa powinni generalnie zainstalować GCC lub Clang, zgodnie z dokumentacją ich

dystrybucji. Na przykład, jeśli używasz Ubuntu, możesz zainstalować pakiet build-essential.

Instalacja rustup pod Windowsem

Z poziomu Windowsa, odwiedź stronę https://www.rust-lang.org/tools/install i kieruj się instrukcjami instalacji Rusta. W którymś momencie procesu otrzymasz komunikat informujący, że będziesz również potrzebować narzędzi budowania MSVC dla Visual Studio 2013 lub nowszego.

Aby uzyskać narzędzia kompilacji, powinieneś zainstalować Visual Studio 2022. Na pytanie, które składniki zainstalować, należy wybrać:

- „Desktop Development with C++”

- The Windows 10 or 11 SDK

- pakiet języka angielskiego, wraz z dowolnym innym pakietem językowym do wyboru

Dalsza część książki będzie zawierać polecenia działające zarówno w cmd.exe jak i w PowerShell. Jeżeli pojawią się jakieś różnice, zostaną one wyjaśnione.

Aktualizowanie i odinstalowanie

Kiedy już zainstalujesz Rusta używając rustup, aktualizacja do najnowszej

wersji jest prosta. W terminalu uruchom następujący skrypt aktualizacji:

$ rustup update

Aby odinstalować Rusta oraz rustup, w terminalu uruchom skrypt dezinstalacji:

$ rustup self uninstall

Rozwiązywanie problemów

Aby sprawdzić, czy Rust jest prawidłowo zainstalowany, otwórz terminal i wpisz następujące polecenie:

$ rustc --version

Powinien się wyświetlić numer wersji, hasz oraz data commita najnowszej wersji stabilnej, w formacie podobnym do poniższego:

rustc x.y.z (abcabcabc rrrr-mm-dd)

Jeśli widzisz coś takiego, Rust zainstalował się prawidłowo! Jeśli nie, to sprawdź

czy Rust został dodany do zmiennej środowiskowej %PATH%.

W Windows CMD, wpisz:

> echo %PATH%

W PowerShellu, wpisz:

> echo $env:Path

W systemie Linux lub macOS, wpisz:

$ echo $PATH

Jeśli wszystko się zgadza, a Rust nadal nie działa, istnieje kilka miejsc, w których możesz uzyskać pomoc. Dowiedz się, jak skontaktować się z innymi Rustowcami (to takie nasze przezwisko) na the community page.

Lokalna dokumentacja

Instalacja dołącza również lokalną kopię dokumentacji, więc można ją czytać

offline. Uruchom rustup doc, żeby otworzyć lokalną dokumentację w swojej

przeglądarce.

Za każdym razem, kiedy przytoczone są typ lub funkcja z biblioteki standardowej, a nie masz pewności co robią lub jak ich użyć, użyj dokumentacji API (Interfejs Programowania Aplikacji), aby się dowiedzieć.

Witaj, świecie!

Ponieważ Rust jest już zainstalowany, napiszmy pierwszy program. Przy poznawaniu nowego języka tradycją stało się tworzenie krótkiego programu, który wyświetla na ekranie tekst „Witaj, świecie! (ang. „Hello World!”). Postąpimy tu tak samo.

Uwaga: Książka zakłada u czytelnika podstawową znajomość wiersza poleceń. Sam Rust nie wymaga konkretnego edytora, narzędzi czy też miejsca, gdzie zapisany jest kod, więc jeśli preferujesz używanie zintegrowanego środowiska programistycznego zamiast wiersza poleceń, masz do tego pełne prawo. Wiele IDE obsługuje Rusta w pewnym stopniu - możesz sprawdzić dokumentację swojego IDE, aby uzyskać szczegóły. Zespół Rusta ostatnio zadbał o obsługę języka w niektórych IDE dzięki

rust-analyzer. Więcej szczegółów zawiera Dodatek D.

Tworzenie katalogu projektu

W pierwszej kolejności utwórz katalog, w którym umieścisz swój kod. Rust w żaden sposób nie narzuca lokalizacji dla kodu, ale dla potrzeb niniejszej książki sugerujemy utworzenie katalogu projects w katalogu domowym i przechowywanie tam wszystkich swoich programów.

Otwórz terminal i wprowadź następujące polecenia, aby utworzyć katalog projects, w którym umieścimy kolejny, pod projekt „Witaj, świecie!”:

Pod Linuksem, macOS, lub w PowerShell pod Windowsem, wpisz to:

$ mkdir ~/projects

$ cd ~/projects

$ mkdir hello_world

$ cd hello_world

W Windows CMD, wpisz to:

> mkdir %USERPROFILE%\projects

> cd /d %USERPROFILE%\projects

> mkdir hello_world

> cd hello_world

Pisanie i uruchamianie programu w Ruście

Następnie utwórz nowy plik źródłowy i nazwij go main.rs. Pliki języka Rust zawsze zakończone są rozszerzeniem .rs. Jeśli w nazwie pliku znajduje się więcej niż jedno słowo, użyj znaku podkreślenia jako separatora. Na przykład, hello_world.rs zamiast helloworld.rs.

Otwórz plik main.rs, który właśnie utworzyłeś i wprowadź kod podany w Listingu 1-1:

Plik: main.rs

fn main() { println!("Witaj, świecie!"); }

Listing 1-1: Program wyświetlający „Witaj, świecie!”

Zapisz plik i wróć do okna terminala w katalogu ~/projects/hello_world. Pod Linuksem lub macOS, wprowadź podane polecenia, żeby skompilować i uruchomić program:

$ rustc main.rs

$ ./main

Witaj, świecie!

Pod Windowsem, uruchom .\main.exe zamiast ./main.

> rustc main.rs

> .\main.exe

Witaj, świecie!

Bez względu na posiadany system operacyjny, powinieneś/powinnaś zobaczyć w oknie

terminala wyświetlony tekst Witaj, świecie!. Jeśli nic takiego nie widzisz,

zajrzyj do sekcji „Rozwiązywanie problemów” w

rozdziale poświęconym instalacji, po sposoby na otrzymanie pomocy.

Jeśli widzisz tekst Witaj, świecie!, to gratulacje! Właśnie oficjalnie napisałeś

program w Ruście, a to czyni z ciebie programistę Rusta - Witaj!

Anatomia programu w Ruście

Przyjrzyjmy się teraz dokładnie, co właściwie dzieje się w twoim programie „Witaj, świecie!”. Oto pierwsza część układanki:

fn main() { }

Powyższe linie definiują w Ruście funkcję. Funkcja main jest szczególna: to

pierwsza rzecz, która wykonuje się w każdym programie napisanym w Ruście. Pierwsza

linia deklaruje funkcję o nazwie main, która nie przyjmuje argumentów oraz

niczego nie zwraca. Gdyby funkcja przyjmowała jakieś argumenty, ich nazwy

umieszczone byłyby w nawiasach, ().

Zwróć też uwagę, że ciało funkcji otoczone jest nawiasami klamrowymi, {}.

Rust wymaga tych znaków wokół ciał wszystkich funkcji. Za dobry styl uważa się

umieszczenie klamry otwierającej w tej samej linii, co deklaracja funkcji i

oddzielenie jej od poprzedzającego kodu jedną spacją.

Uwaga: Jeśli chcesz trzymać się ściśle standardowego stylu używanego w Rustowych projektach, możesz użyć

rustfmt-- narzędzia do automatycznego formatowania kodu do konkretnego stylu (więcej orustfmtjest w Dodatku D). Programu zawarty jest w standardowej dystrybucji Rusta, tak jakrustc, więcrustfmtprawdopodobnie już zainstalowany na twoim komputerze!

Wewnątrz funkcji main mamy następujący kod:

#![allow(unused)] fn main() { println!("Witaj, świecie!"); }

Ta linia wykonuje całą robotę w naszym krótkim programie: wyświetla tekst na ekranie. Należy tu zwrócić uwagę na cztery szczegóły.

Po pierwsze, wcięcie tekstu w Ruście składa się z czterech spacji, a nie z tabulatora.

Po drugie, println! wywołuje w Ruście makro. Gdyby wywoływana była

funkcja, wpisana byłaby jako println (bez !). Makra będą szerzej opisane w

rozdziale 19. Jedyne, co musisz wiedzieć teraz, to to, że użycie ! wywołuje

makro zamiast zwykłej funkcji i że makra nie zawsze podlegają tym samym regułą co funkcje.

Po trzecie, w programie widzimy łańcuch znaków (string) "Witaj, świecie!".

Przekazujemy go jako argument do println!, którego ostatecznym efektem jest

wyświetlenie łańcucha na ekranie.

Po czwarte, linia zakończona jest średnikiem (;), który oznacza, że bieżące

wyrażenie jest zakończone i można zacząć kolejne. Większość linii w Ruście

kończy się znakiem średnika.

Kompilacja i uruchomienie to oddzielne kroki

Przed momentem uruchomiliśmy nowo napisany program. Zbadajmy teraz kolejno każdy poprzedzający ten moment etap.

Zanim uruchomisz program w Ruście, należy go skompilować kompilatorem Rusta,

wprowadzając polecenie rustc i przekazując do niego jako argument nazwę pliku

źródłowego. Wygląda to tak:

$ rustc main.rs

Jeśli masz doświadczenie w C lub C++, zauważysz, że jest to podobne do

wywoływania gcc lub clang. Po udanej kompilacji, Rust tworzy binarny plik

wykonywalny.

Pod Linuksem, macOS lub w PowerShell pod Windowsem możesz sprawdzić obecność

pliku wykonywalnego używając w terminalu polecenia ls:

$ ls

main main.rs

W przypadku Linuksa i macOS zobaczysz dwa pliki. PowerShell pod Windowsem wyświetli trzy pliki - te same, które wyświetliłby CMD. W CMD pod Windowsem możesz wpisać:

> dir /B %= opcja /B powoduje wyświetlenie jedynie nazw plików =%

main.exe

main.pdb

main.rs

To potwierdza obecność kodu źródłowego z rozszerzeniem .rs, programu wykonywalnego (main.exe pod Windowsem, main wszędzie indziej), a także, w przypadku Windowsa, pliku z rozszerzeniem .pdb zawierającego informacje debugujące. Wszystko, co pozostało do zrobienia, to uruchomienie pliku main lub main.exe, w taki sposób:

$ ./main # lub .\main.exe pod Windowsem

Jeżeli main.rs jest twoim programem „Witaj, świecie!”, wyświetli to w oknie

terminala tekst Witaj, świecie!.

Jeśli jesteś doświadczony w językach dynamicznych, takich jak Ruby, Python lub

JavaScript, możesz nie być przyzwyczajony do traktowania kompilacji i

uruchomienia programu jako oddzielnych kroków. Rust jest językiem kompilowanym

z wyprzedzeniem, co oznacza, że możesz skompilować program i dać go komuś,

kto uruchomi go nawet nie mając zainstalowanego Rusta. Jeśli natomiast dasz

komuś plik .rb, .py lub .js, odbiorca musi mieć zainstalowane

odpowiednio implementacje Ruby, Pythona lub JavaScript. Jednak w tych językach

jedna komenda wystarczy, aby jednocześnie skompilować i uruchomić program.

Wszystko jest kompromisem w konstrukcji danego języka.

Kompilacja poprzez rustc jest wystarczająca dla prostych programów, ale w

miarę rozrastania się twojego projektu, odczujesz potrzebę zarządzania

wszystkimi dostępnymi w nim opcjami i ułatwienia dzielenia się kodem.

W dalszym ciągu przedstawimy narzędzie zwane Cargo, które pomoże ci w pisaniu

prawdziwych programów w Ruście.

Witaj, Cargo!

Cargo jest menedżerem pakietów i systemem budowania Rusta. Większość Rustowców używa tego narzędzia do zarządzania swoimi projektami, ponieważ Cargo potrafi wykonać za nich wiele zadań, takich jak budowanie kodu oraz ściąganie i budowanie bibliotek, od których kod jest zależny. Biblioteki, których wymaga twój kod nazywamy zależnościami (dependencies).

Najprostsze programy w Ruście, takie jak ten, który właśnie napisaliśmy, nie mają żadnych zależności, więc gdybyśmy zbudowali projekt „Witaj, świecie!” (ang. „Hello World!”) za pomocą Cargo, zostałaby użyta tylko ta część narzędzia, która zajmuje się budowaniem kodu. W miarę pisania bardziej skomplikowanych programów, zechcesz dodawać zależności i jeśli swój projekt rozpoczniesz z użyciem Cargo, będzie to o wiele łatwiejsze do zrobienia.

Jako że przeważająca większość projektów w Ruście używa Cargo, w dalszym ciągu książki założymy, że ty również go używasz. Jeśli korzystałeś(-aś) z oficjalnych instalatorów, zgodnie z opisem w sekcji „Instalacja”, Cargo zainstalował się razem z Rustem. Jeżeli instalowałeś(-aś) Rusta w inny sposób, możesz sprawdzić, czy Cargo jest zainstalowany, przez wprowadzenie w terminalu następującej komendy:

$ cargo --version

Jeżeli widzisz numer wersji, Cargo jest zainstalowane! Jeśli natomiast pojawia

się błąd z rodzaju komendy nie znaleziono, powinieneś/powinnaś zajrzeć do dokumentacji

swojej metody instalacji celem ustalenia, jak zainstalować Cargo osobno.

Tworzenie projektu z Cargo

Stwórzmy nowy projekt z pomocą Cargo i przyjrzyjmy się, czym różni się on od naszego pierwotnego projektu „Witaj, świecie!”. Przejdź z powrotem do swojego katalogu projects (lub innego, w którym zdecydowałeś(-aś) się trzymać swój kod) i bez względu na posiadany system operacyjny wprowadź polecenie:

$ cargo new hello_cargo

$ cd hello_cargo

Pierwsze polecenie stworzy nowy katalog o nazwie hello_cargo. Ponieważ nadaliśmy naszemu projektowi nazwę hello_cargo, Cargo tworzy jego pliki źródłowe w katalogu o tej samej nazwie.

Wejdź do katalogu hello_cargo i wyświetl listę plików. Powinieneś(-aś) zobaczyć, że

Cargo utworzył dla nas dwa pliki i jeden podkatalog: plik Cargo.toml oraz

katalog src z plikiem main.rs wewnątrz. Zainicjował również nowe

repozytorium Gita, w komplecie z plikiem .gitignore.

Gdybyś jednak wykonał(a) komendę cargo new w folderze, w którym istnieje już

repozytorium Gita, to pliki związane z Gitem nie zostałyby stworzone.

Możesz zmienić to zachowanie używając komendy cargo new --vcs=git.

Uwaga: Git jest często stosowanym systemem kontroli wersji. Możesz zlecić

cargo newzastosowanie innego systemu kontroli wersji lub też nie stosowanie żadnego, za pomocą flagi--vcs. Uruchomcargo new --help, żeby zobaczyć dostępne opcje.

Otwórz plik Cargo.toml w wybranym przez siebie edytorze tekstu. Zawartość powinna wyglądać podobnie do kodu z listingu 1-2:

Plik: Cargo.toml

[package]

name = "hello_cargo"

version = "0.1.0"

edition = "2021"

# See more keys and their definitions at https://doc.rust-lang.org/cargo/reference/manifest.html

[dependencies]

Listing 1-2: Zawartość pliku Cargo.toml wygenerowanego

przez cargo new

Plik jest w formacie TOML (Tom’s Obvious, Minimal Language) (Oczywisty, Minimalistyczny Język Toma - przyp. tłum.), którego Cargo używa do konfiguracji.

Pierwsza linia, [package], jest nagłówkiem sekcji, której kolejne wyrażenia

konfigurują pakiet. W miarę dodawania informacji do tego pliku, dodamy też inne

sekcje.

Następne trzy linie ustalają informacje konfiguracyjne, których Cargo

potrzebuje do kompilacji twojego programu: nazwę, wersję, i dane o

używanej edycji Rusta. O kluczu edition będzie mowa w Dodatku E.

Ostatnia linia, [dependencies], rozpoczyna sekcję, gdzie wyszczególnia się

wszystkie zależności twojego projektu. W Ruście pakiety z kodem źródłowym

nazywane są skrzyniami (crates). Do tego projektu nie będziemy potrzebować

żadnych skrzyń, ale do programu w rozdziale drugim owszem. Wówczas przyda nam

się sekcja zależności.

Otwórz teraz plik src/main.rs i przyjrzyj się zawartości:

Plik: src/main.rs

fn main() { println!("Hello, world!"); }

Cargo wygenerował dla ciebie program „Witaj, świecie!”, prawie taki sam jak ten, jak napisaliśmy w listingu 1-1 (tyle, że w języku angielskim)! Różnice między naszym poprzednim projektem, a tym wygenerowanym przez Cargo są takie, że w Cargo kod źródłowy trafia do podkatalogu src, a w katalogu głównym pozostaje plik konfiguracyjny Cargo.toml.

Cargo zakłada, że kod źródłowy znajduje się w podkatalogu src, dzięki czemu katalog główny wykorzystany jest tylko na pliki README, informacje o licencjach, pliki konfiguracyjne i wszystko inne, co nie jest kodem. Używanie Cargo pomaga utrzymać ci własne projekty w należytym porządku. Na wszystko jest miejsce i wszystko jest na swoim miejscu.

Jeżeli zacząłeś(-aś) jakiś projekt bez użycia Cargo, taki jak nasz poprzedni z katalogu hello_world, możesz przekonwertować go na wersję kompatybilną z Cargo, przenosząc kod źródłowy do podkatalogu src i tworząc odpowiedni plik Cargo.toml.

Budowanie i uruchamianie projektu z Cargo

Przyjrzyjmy się teraz, jakie są różnice w budowaniu i uruchamianiu programu „Witaj, świecie!” poprzez Cargo. Aby zbudować swój projekt, z poziomu głównego katalogu hello_cargo wprowadź polecenie:

$ cargo build

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 2.85 secs

Spowoduje to utworzenie pliku wykonywalnego w target/debug/hello_cargo (lub target\debug\hello_cargo.exe pod Windowsem), zamiast w katalogu bieżącym. Ponieważ domyślnie budowana jest wersja debug programu, Cargo umieszcza skompilowany plik binarny w katalogu debug. Plik można uruchomić następującym poleceniem:

$ ./target/debug/hello_cargo # lub .\target\debug\hello_cargo.exe pod Windowsem

Hello, world!

Jeśli wszystko przebiegło prawidłowo, Hello, world! powinno

wyświetlić się w oknie terminala. Uruchomienie cargo build za pierwszym razem

powoduje dodatkowo utworzenie przez Cargo nowego pliku w katalogu głównym o

nazwie Cargo.lock, który wykorzystywany jest do śledzenia dokładnych wersji

zależności w twoim projekcie. Ponieważ bieżący projekt nie posiada zależności,

zawartość pliku jest dość licha. Nie będziesz musiał własnoręcznie modyfikować

tego pliku; Cargo zajmie się tym za ciebie.

Właśnie zbudowaliśmy projekt poleceniem cargo build i uruchomiliśmy go przez

./target/debug/hello_cargo. Możemy również użyć cargo run, żeby skompilować

i uruchomić program za jednym rzutem:

$ cargo run

Finished dev [unoptimized + debuginfo] target(s) in 0.0 secs

Running `target/debug/hello_cargo`

Hello, world!

Większość programistów używa cargo run, bo jest ono wygodniejsze i łatwiejsze do zapamiętania od użycia cargo build i pełnej ścieżki do zbudowanego pliku binarnego.

Zauważ, że tym razem nie wyświetliła się informacja o tym, że Cargo kompilował

hello_cargo. Program wywnioskował, że zawartość plików nie uległa zmianie,

więc po prostu uruchomił binarkę. Gdyby kod źródłowy został zmodyfikowany, Cargo

przebudowałby projekt przed jego uruchomieniem i wówczas informacja na ekranie

wyglądałaby następująco:

$ cargo run

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 0.33 secs

Running `target/debug/hello_cargo`

Hello, world!

Mamy jeszcze do dyspozycji cargo check. To polecenie szybko sprawdzi twój kod,

celem upewnienia się, że skompilowałby się on prawidłowo, ale nie tworzy pliku

wykonywalnego:

$ cargo check

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 0.32 secs

Jaki jest cel pomijania tworzenia binarki? Taki, że cargo check jest często o

wiele szybsze od cargo build, ponieważ cały krok generowania pliku

wykonywalnego jest pomijany. Jeśli masz zwyczaj sprawdzać swoją pracę w trakcie

pisania kodu, użycie cargo check przyspieszy proces! Wielu Rustowców okresowo

uruchamia cargo check, żeby sprawdzić, czy wszystko się kompiluje, a

cargo build dopiero, kiedy zdecydują się na uruchomienie binarki.

Podsumujmy, co do tej pory nauczyliśmy się o Cargo:

- Możemy stworzyć projekt używając

cargo new. - Możemy zbudować projekt poleceniami

cargo build. - Możemy zbudować i uruchomić projekt w jednym kroku z użyciem

cargo run. - Możemy zbudować projekt bez tworzenia binarki, aby sprawdzić błędy używając

cargo check. - Zamiast umieszczać pliki wynikowe budowania w tym samym katalogu co nasz kod, Cargo umieści je w podkatalogu target/debug.

Dodatkową zaletą używania Cargo jest to, że polecenia są identyczne, bez względu na system operacyjny, pod którym pracujesz. Od tego momentu nie będziemy zatem podawać osobnych instrukcji dla Linuksa i macOS czy Windowsa.

Budowanie do publikacji

Gdy twój projekt jest już gotowy do publikacji, możesz użyć polecenia

cargo build --release celem przeprowadzenia kompilacji z optymalizacjami.

Spowoduje to utworzenie pliku wykonywalnego w podkatalogu target/release

zamiast w target/debug. Przeprowadzone optymalizacje sprawiają, że twój

program w Ruście wykonuje się szybciej, ale jednocześnie jego kompilacja trwa

dłużej. Dlatego też istnieją dwa różne profile: jeden rozwojowy, kiedy zależy ci

na szybkim i częstym budowaniu oraz drugi, przeznaczony do zbudowania

ostatecznej wersji, która trafi do użytkownika. Nie będzie ona wielokrotnie

przebudowywana, ale wykonywać się będzie tak szybko, jak to tylko możliwe.

Jeżeli prowadzisz testy czasu wykonywania swojego kodu, pamiętaj o wywołaniu

cargo build --release i testowaniu pliku wykonywalnego z

podkatalogu target/release.

Cargo jako konwencja

W przypadku prostych projektów, Cargo nie wnosi wielu korzyści w porównaniu z

używaniem prostego rustc, ale udowodni swoją wartość w miarę postępów. Przy

skomplikowanych projektach złożonych z wielu plików lub mających wiele zależności,

zezwolenie Cargo na koordynację budowania znacznie ułatwia pracę.

Nawet jeśli projekt hello_cargo jest prosty, używa już sporej części arsenału

narzędzi, z którymi będziesz mieć do czynienia przez pozostały okres swojej

kariery z Rustem. Rzeczywiście, rozpoczęcie pracy nad jakimkolwiek istniejącym

projektem sprowadza się do wydania kilku poleceń: check out kodu w Git,

wejście do katalogu roboczego i budowanie:

$ git clone przyklad.org/jakisprojekt

$ cd jakisprojekt

$ cargo build

Więcej informacji o Cargo można znaleźć w jego dokumentacji.

Podsumowanie

Jesteś już na dobrej drodze do rozpoczęcia podróży z Rustem! W tym rozdziale nauczyłeś(-aś) się, jak:

- Zainstalować najnowszą, stabilną wersję Rusta z użyciem

rustup, - Uaktualnić Rusta do nowszej wersji,

- Otwierać lokalną kopię dokumentacji,

- Napisać program „Witaj, świecie!” używając bezpośrednio

rustc, - Stworzyć i uruchomić nowy projekt używając konwencji Cargo.

To świetna pora na stworzenie poważniejszego programu, aby przyzwyczaić się do czytania i pisania kodu w Ruście. W następnym rozdziale zbudujemy program grający w zgadywankę. Jeśli jednak chcesz zacząć naukę o działaniu powszechnych pojęć programistycznych w Ruście, przejdź do rozdziału 3, a następnie wróć do rozdziału 2.

Piszemy grę zgadywankę

Rozpocznijmy zabawę z Rustem tworząc razem praktyczny projekt. Ten rozdział zapozna cię z kilkoma podstawowymi

konceptami Rusta, prezentując ich użycie w prawdziwym programie. Dowiesz się, co oznaczają let, match, metoda,

funkcja powiązana (associated function), nauczysz się, jak używać skrzyń (crates), i wielu innych rzeczy!

Dokładniejsze omówienie tych tematów znajduje się w dalszych rozdziałach. W tym rozdziale przećwiczysz jedynie podstawy.

Zaimplementujemy klasyczny problem programistyczny dla początkujących: grę zgadywankę. Oto zasady: program generuje losową liczbę całkowitą z przedziału od 1 do 100. Następnie prosi użytkownika o wprowadzenie liczby z tego przedziału. Gdy użytkownik wprowadzi swoją odpowiedź, program informuje, czy podana liczba jest niższa czy wyższa od wylosowanej. Gdy gracz odgadnie wylosowaną liczbę, program wyświetla gratulacje dla zwycięzcy i kończy działanie.

Tworzenie nowego projektu

Aby stworzyć nowy projekt, wejdź do folderu projects utworzonego w rozdziale 1 i za pomocą Cargo wygeneruj szkielet projektu, w ten sposób:

$ cargo new guessing_game

$ cd guessing_game

Pierwsza komenda, cargo new, jako argument przyjmuje nazwę projektu (guessing_game).

W kolejnej linii komenda cd przenosi nas do nowo utworzonego folderu projektu.

Spójrz na wygenerowany plik Cargo.toml:

Plik: Cargo.toml

[package]

name = "guessing_game"

version = "0.1.0"

edition = "2021"

# See more keys and their definitions at https://doc.rust-lang.org/cargo/reference/manifest.html

[dependencies]

Jak już widziałeś w rozdziale 1, cargo new tworzy dla ciebie program

„Hello World!”. Otwórz plik src/main.rs:

Plik: src/main.rs

fn main() { println!("Hello, world!"); }

Teraz skompilujemy i uruchomimy ten program w jednym kroku za pomocą komendy cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 1.50s

Running `target/debug/guessing_game`

Hello, world!

Komenda run jest przydatna, kiedy chcesz w szybki sposób testować kolejne iteracje rozwoju projektu.

Tak właśnie jest w przypadku naszej gry: chcemy testować każdy krok, zanim przejdziemy do kolejnego.

Otwórz jeszcze raz plik src/main.rs. W tym pliku będziesz pisał kod programu.

Przetwarzanie odpowiedzi

Pierwsza część programu będzie prosiła użytkownika o podanie liczby, przetwarzała jego odpowiedź i sprawdzała, czy wpisane przez niego znaki mają oczekiwaną postać. Zaczynamy od wczytania odpowiedzi gracza. Przepisz kod z listingu 2-1 do pliku src/main.rs.

Plik: src/main.rs

use std::io;

fn main() {

println!("Zgadnij numer!");

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

println!("Wybrana przez ciebie liczba: {guess}");

}Listing 2-1: Implementacja wczytująca odpowiedź użytkownika i wypisująca ją na ekran

Powyższy fragment kodu zawiera dużo informacji - przeanalizujmy go kawałek po kawałku. Aby wczytać odpowiedź gracza

a następnie wyświetlić ją na ekranie, musimy dołączyć do programu bibliotekę io (input/output).

Biblioteka io pochodzi z biblioteki standardowej (znanej jako std):

use std::io;

fn main() {

println!("Zgadnij numer!");

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

println!("Wybrana przez ciebie liczba: {guess}");

}Domyślnie Rust posiada zestaw elementów zdefiniowanych w bibliotece standardowej, które importuje do każdego programu. Ten zestaw nazywany jest prelude i można zobaczyć co zawiera w dokumentacji biblioteki standardowej.

Jeśli typu, którego chcesz użyć, nie ma w prelude, musisz go jawnie zaciągnąć używając słowa use.

Skorzystanie z biblioteki std::io dostarcza wielu pożytecznych mechanizmów związanych z io,

włącznie z funkcjonalnością do wczytywania danych wprowadzonych przez użytkownika.

Tak jak mówiliśmy już w rozdziale 1, każdy program rozpoczyna wykonanie w funkcji main.

use std::io;

fn main() {

println!("Zgadnij numer!");

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

println!("Wybrana przez ciebie liczba: {guess}");

}fn deklaruje nową funkcję, () informuje, że funkcja ta nie przyjmuje żadnych parametrów,

a { otwiera ciało funkcji.

W rozdziale 1 nauczyłeś się również, że println! jest makrem, które wyświetla zawartość stringa na ekranie:

use std::io;

fn main() {

println!("Zgadnij numer!");

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

println!("Wybrana przez ciebie liczba: {guess}");

}Powyższy fragment kodu wypisuje na ekranie informację, na czym polega gra, i prosi użytkownika o wprowadzenie odgadniętej przez niego liczby.

Zapisywanie wartości w zmiennych

Teraz stworzymy zmienną do zapisywania odpowiedzi użytkownika, w ten sposób:

use std::io;

fn main() {

println!("Zgadnij numer!");

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

println!("Wybrana przez ciebie liczba: {guess}");

}

Program robi się coraz bardziej interesujący! W tej krótkiej linii wiele się dzieje.

Instrukcji let używamy do utworzenia zmiennej. Tutaj kolejny przykład:

let apples = 5;W tej linii tworzona jest nowa zmienna o nazwie apples, do której przypisana jest wartość 5.

W Ruście wszystkie zmienne są domyślnie niemutowalne (stałe), co oznacza, że nadana im na początku wartość nie zmieni się.

We’ll be discussing this concept in detail in the „Variables and Mutability”

section in Chapter 3.

Poniższy przykład pokazuje, jak stawiając słowo kluczowe mut przed nazwą zmiennej stworzyć zmienną mutowalną:

let apples = 5; // immutable

let mut bananas = 5; // mutableUwaga: Znaki

//rozpoczynają komentarz, który ciągnie się do końca linii. Rust ignoruje zawartość komentarzy. Komentarze omówimy bardziej szczegółowo w rozdziale 3.

Powróćmy do naszej gry-zgadywanki.

Teraz już wiesz, że let mut guess utworzy mutowalną zmienną o nazwie guess.

Po prawej stronie znaku przypisania (=) jest wartość, która jest przypisywana do guess,

i która jest wynikiem wywołania funkcji String::new, tworzącej nową instancję Stringa.

String to dostarczany przez bibliotekę standardową typ tekstowy,

gdzie tekst ma postać UTF-8 i może się swobodnie rozrastać.

Znaki :: w wyrażeniu ::new wskazują na to, że new jest funkcją powiązaną (associated

function) z typem String. Funkcje powiązane są zaimplementowane na danym typie, w tym

przypadku na Stringu, a nie na konkretnej instancji typu String

(niektóre języki programowania nazywają to metodą statyczną).

Funkcja new tworzy nowy, pusty String. W przyszłości spotkasz się z funkcjami new

dla wielu różnych typów, ponieważ jest to standardowa nazwa dla funkcji tworzącej nową

instancję danego typu.

Podsumowując, linia let mut guess = String::new(); stworzyła mutowalną zmienną, która jest obecnie przypisania do nowej, pustej instancji typu String. Uff!

Pobieranie danych od użytkownika

Przypominasz sobie, że załączyliśmy do programu obsługę wejścia/wyjścia z biblioteki

standardowej przy pomocy linii use std::io;?

Teraz wywołamy z stdin funkcję znajdującą się w module io, które pozwoli nam na pobranie danych od użytkownika:

use std::io;

fn main() {

println!("Zgadnij numer!");

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

println!("Wybrana przez ciebie liczba: {guess}");

}Gdybyśmy nie zaimportowali io za pomocą use std::io na początku programu, aby wywołać tę funkcję musielibyśmy

napisać std::io::stdin.

Funkcja stdin zwraca instancję std::io::Stdin,

która jest typem reprezentującym uchwyt do standardowego wejścia dla twojego terminala.

Dalszy fragment kodu, .read_line(&mut guess), wywołuje metodę read_line

na uchwycie wejścia standardowego, aby w ten sposób wczytać znaki wprowadzone przez gracza.

Do metody read_line podajemy argument &mut guess, by wskazać gdzie zapisać wczytane znaki.

Zadaniem metody read_line jest wziąć to, co użytkownik wpisze na wejście standardowe i dodać to

do podanego string (bez nadpisania jego zawartości), który przyjmuje ona jako argument.

String ten musi być mutowalny, aby metoda była w stanie go zmodyfikować.

Znak & wskazuje na to, że argument guess jest referencją. Referencja oznacza, że wiele kawałków kodu może operować

na jednej instancji danych, bez konieczności kopiowania tej danej kilkakrotnie. Referencje są skomplikowane,

a jedną z głównych zalet Rusta jest to, jak bezpiecznie i łatwo można ich używać.

Do dokończenia tego programu nie musisz znać wielu szczegółów na ten temat: rozdział 4 omówi referencje bardziej

wnikliwie. Póki co wszystko co musisz wiedzieć o referencjach to to, że podobnie jak zmienne, domyślnie są niemutowalne.

Dlatego musimy napisać &mut guess, a nie &guess, aby dało się tę referencję modyfikować.

Obsługa potencjalnych błędów z użyciem Result

Nie skończyliśmy jeszcze analizy tej linii kodu. Pomimo tego że doszliśmy już do trzeciej linii tekstu, wciąż jest to część pojedynczej, logicznej linii kodu. Kolejną częścią jest ta metoda:

use std::io;

fn main() {

println!("Zgadnij numer!");

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

println!("Wybrana przez ciebie liczba: {guess}");

}Moglibyśmy napisać ten kod tak:

io::stdin().read_line(&mut guess).expect("Błąd wczytania linii");Jednakże taka długa linia jest trudna do czytania, więc lepiej ją podzielić. Często warto złamać linię i wprowadzić dodatkowe wcięcie, by poprawić czytelność długich wywołań ze składnią typu .nazwa_metody().

Teraz omówimy, co ta linia robi.

Jak już wspomnieliśmy wcześniej, read_line zapisuje tekst wpisany przez użytkownika do stringa przekazanego jako argument. Ale również zwraca wartość typu Result.

Result jest enumeracją, często nazywaną enumem lub typamem wyliczeniowym.

Typ wyliczeniowy to typ, który może mieć stały zestaw wartości, nazywanych wariantami (variants).

Chapter 6 will cover enums in more detail. The purpose of these Result types is to encode error-handling information.

Możliwe wartości Result to Ok i Err. Ok oznacza, że operacja powiodła się sukcesem i wewnątrz obiektu Ok znajduje się poprawnie wygenerowana wartość. Err oznacza, że operacja nie powiodła się, i obiekt Err zawiera informację o przyczynach niepowodzenia.

Obiekty typu Result, tak jak obiekty innych typów,

mają zdefiniowane dla siebie metody. Instancja Result ma metodę expect,

którą możesz wywołać. Jeśli dana instancja Result będzie miała wartość Err, wywołanie metody expect spowoduje zakończenie się programu i wyświetlenie na ekranie wiadomości, którą podałeś jako argument do expect. Sytuacje, gdy metoda read_line zwraca Err, najprawdopodobniej są wynikiem błędu pochodzącego z systemu operacyjnego. Gdy zaś zwrócony Result ma wartość Ok,

expect odczyta wartość właściwą, przechowywaną przez Ok, i zwróci tę wartość, gotową do użycia w programie.

W tym przypadku wartość ta odpowiada liczbie bajtów, które użytkownik wprowadził na wejście.

Gdybyśmy pominęli wywołanie expect, program skompilowałby się z ostrzeżeniem:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

warning: unused `Result` that must be used

--> src/main.rs:10:5

|

10 | io::stdin().read_line(&mut guess);

| ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

|

= note: this `Result` may be an `Err` variant, which should be handled

= note: `#[warn(unused_must_use)]` on by default

warning: `guessing_game` (bin "guessing_game") generated 1 warning

Finished dev [unoptimized + debuginfo] target(s) in 0.59s

Rust ostrzega, że nie zrobiliśmy nic z wartością Result zwróconą z read_line, a co za tym idzie,

program nie obsłużył potencjalnego błędu. Sposobem na pozbycie się tego ostrzeżenia jest dopisanie obsługi błędów. Tutaj jednak chcemy, by program zakończył się, gdy nie uda się odczytać odpowiedzi użytkownika,

więc możemy użyć expect. O wychodzeniu ze stanu błędu przeczytasz w rozdziale 9.

Wypisywanie wartości z pomocą println! i placeholderów

Poza klamrą zamykającą program, w kodzie który dotychczas napisaliśmy została już tylko jedna linia do omówienia:

use std::io;

fn main() {

println!("Zgadnij numer!");

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

println!("Wybrana przez ciebie liczba: {guess}");

}Ta linia wyświetla na ekranie łańcuch, w którym zapisaliśmy odpowiedź użytkownika. Zestaw {} nawiasów

nawiasów klamrowych to placeholder: pomyśl o {} jak o małych szczypcach kraba, które trzymają

wartość w miejscu. Podczas wypisywania wartości zmiennej, nazwa zmiennej może

znajdować się wewnątrz nawiasów klamrowych. By wypisać wynik

wyrażenia, umieść puste nawiasy klamrowe w łańcuchu formatującym,

a za łańcuchem same wyrażenia, oddzielone przecinkami, po jednym dla kolejnych pustych nawiasów klamrowych.

Wyświetlanie zmiennej i wyniku wyrażenia w jednym wywołaniu println! wyglądałoby tak:

#![allow(unused)] fn main() { let x = 5; let y = 10; println!("x = {x} i y + 2 = {}", y + 2); }

Ten kod wypisze na ekran x = 5 i y + 2 = 12.

Testowanie pierwszej część programu

Przetestujmy pierwszą część Zgadywanki. Uruchom grę poleceniem cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 2.53 secs

Running `target/debug/guessing_game`

Zgadnij numer!

Podaj swoją liczbę:

6

Wybrana przez ciebie liczba: 6

W tym miejscu pierwsza część gry jest gotowa: wczytujemy odpowiedź użytkownika z klawiatury i wypisujemy ją na ekranie.

Generowanie sekretnej liczby

Następnie musimy wygenerować sekretną liczbę, którą gracz będzie próbował odgadnąć.

Sekretna liczba powinna zmieniać się przy każdym uruchomieniu programu, aby gra bawiła więcej niż raz.

Użyjmy losowej liczby z przedziału od 1 do 100, żeby odgadnięcie jej nie było zbyt trudne.

W bibliotece standardowej Rusta nie ma jeszcze obsługi liczb losowych, dlatego musimy sięgnąć do skrzyni

rand.

Więcej funkcjonalności z użyciem skrzyń

Zapamiętaj: skrzynia (ang. crate) to kolekcja plików źródłowych Rusta.

Projekt, który budujemy, to skrzynia binarna

(binary crate), czyli plik wykonywalny. Skrzynia rand to library crate, czyli biblioteka stworzona do używania w

innych programach.

Z użyciem Cargo dodawanie zewnętrznych pakietów jest bajecznie proste. Aby móc używać rand w naszym kodzie,

wystarczy zmodyfikować plik Cargo.toml tak, aby zaciągał skrzynię rand jako zależność do projektu.

Otwórz Cargo.toml i dodaj na końcu, pod nagłówkiem sekcji [dependencies], poniższą linię.

Upewnij się, że podałeś rand dokładnie tak jak poniżej, z

z tym samym numerem wersji. Inaczej kody zawarte w tym tutorialu mogą nie zadziałać:

Plik: Cargo.toml

[dependencies]

rand = "0.8.5"

Plik Cargo.toml podzielony jest na sekcje, których ciało zaczyna się po nagłówku i kończy się w miejscu, gdzie zaczyna się kolejna sekcja. W sekcji [dependencies] informujesz Cargo, jakich zewnętrznych skrzyń i w której wersji wymaga twój projekt. Tutaj przy skrzyni rand znajduje się specyfikator wersji 0.8.5.

Cargo rozumie Semantic Versioning (nazywane tez czasem SemVer), które to jest standardem zapisywania numeru wersji. Numer 0.8.5 jest właściwie skrótem do ^0.8.5, które oznacza wersję conajmniej 0.8.5, ale poniżej 0.9.0.

Cargo considers these versions to have public APIs compatible with version 0.8.5, and this specification ensures you’ll get the latest patch release that will still compile with the code in this chapter. Any version 0.9.0 or greater is not guaranteed to have the same API as what the following examples use.

Teraz bez zmieniania niczego w kodzie przekompilujmy projekt, tak jak przedstawia listing 2-2:

$ cargo build

Updating crates.io index

Downloaded rand v0.8.5

Downloaded libc v0.2.127

Downloaded getrandom v0.2.7

Downloaded cfg-if v1.0.0

Downloaded ppv-lite86 v0.2.16

Downloaded rand_chacha v0.3.1

Downloaded rand_core v0.6.3

Compiling libc v0.2.127

Compiling getrandom v0.2.7

Compiling cfg-if v1.0.0

Compiling ppv-lite86 v0.2.16

Compiling rand_core v0.6.3

Compiling rand_chacha v0.3.1

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 2.53s

Listing 2-2: Wynik po wywołaniu cargo build po dodaniu zależności do skrzyni rand

Być może u siebie zobaczysz inne numery wersji (jednak wszystkie będą kompatybilne z kodem, dzięki SemVer!), inne linie (zależnie od systemu operacyjnego), lub linie wydrukowane w innej kolejności.

Teraz kiedy mamy już zdefiniowaną jakąś zewnętrzną zależność, Cargo ściąga najnowsze wersje wszystkich skrzyń z rejestru, który jest kopią danych z Crates.io. Crates.io to miejsce, gdzie ludzie związani z Rustem publikują dla innych swoje otwarto-źródłowe projekty.

Po zaktualizowaniu rejestru Cargo sprawdza sekcję [dependencies] i ściąga skrzynie, jeśli jakichś brakuje.

W tym przypadku, pomimo że podaliśmy do zależności jedynie skrzynę rand, Cargo ściągnął jeszcze inne skrzynie,

od których zależny jest rand. Po ich ściągnięciu Rust je kompiluje, a następnie, mając już dostępne

niezbędne zależności, kompiluje projekt.

Gdybyś teraz bez wprowadzania jakichkolwiek zmian wywołał ponownie cargo build, nie zobaczyłbyś nic ponad linię Finished.

Cargo wie, że zależności są już ściągnięte i skompilowane, i że nie zmieniałeś nic w ich kwestii w pliku Cargo.toml.

Cargo również wie, że nie zmieniałeś nic w swoim kodzie, więc jego też nie rekompiluje. Nie ma nic do zrobienia,

więc po prostu kończy swoje działanie.

Jeśli wprowadzisz jakąś trywialną zmianę w pliku src/main.rs, zapiszesz, a następnie ponownie zbudujesz projekt, zobaczysz jedynie dwie linijki na wyjściu:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 2.53 secs

Te dwie linie pokazują, że Cargo przebudował uwzględniając jedynie twoją maleńką zmianą z pliku src/main.rs. Zależności nie zmieniły się, więc Cargo wie, że może użyć ponownie te, które już raz ściągnął i skompilował.

Plik Cargo.lock zapewnia powtarzalność kompilacji

Cargo posiada mechanizm, który zapewnia że za każdym razem, gdy ty lub ktokolwiek inny będziecie przebudowywać projekt,

kompilowane będą te same artefakty: Cargo użyje zależności w konkretnych wersjach, chyba że wskażesz inaczej.

Na przykład, co by się stało, gdyby za tydzień wyszła nowa wersja skrzyni rand 0.8.6, która zawierałaby poprawkę istotnego błędu,

ale jednocześnie wprowadza regresję, która zepsuje twój kod?

Odpowiedzią na ten problem jest plik Cargo.lock, który został stworzony w momencie,

gdy po raz pierwszy wywołałeś cargo build. Znajduje się on teraz w twoim folderze guessing_game.

Kiedy po raz pierwszy budujesz dany projekt, Cargo sprawdza wersje każdej z zależności, tak by kryteria były spełnione,

i wynik zapisuje w pliku Cargo.lock. Od tego czasu przy każdym kolejnym budowaniu, Cargo widząc, że plik Cargo.lock

istnieje, będzie odczytywać z niego wersje zależności do pobrania, zamiast na nowo próbować je określać.

Dzięki temu twoje kompilacje są automatycznie reprodukowalne. Innymi słowy, twój projekt będzie wciąż używał wersji 0.8.5,

do czasu aż sam jawnie nie wykonasz aktualizacji.

Ponieważ plik Cargo.lock jest ważny dla powtarzalnych kompilacji,

jest on często umieszczany w systemie kontroli wersji wraz z resztą kodu w projekcie.

Aktualizowanie skrzyni do nowszej wersji

Kiedy chcesz zmienić wersję skrzyni na nowszą, możesz skorzystać z komendy update dostarczanej przez Cargo, która

zignoruje plik Cargo.lock i wydedukuje na nowo najświeższe wersje skrzyń, które pasują do twojej specyfikacji z Cargo.toml.

Cargo zapisze te wersje do pliku Cargo.lock.

Jednak domyślnie Cargo będzie szukało jedynie wersji większej od 0.8.5 i mniejszej od 0.9.0.

Jeśli skrzynia rand została wypuszczona w dwóch nowych wersjach, 0.8.6 i 0.9.0,

po uruchomieniu cargo update zobaczysz taki wynik:

$ cargo update

Updating crates.io index

Updating rand v0.8.5 -> v0.8.6

Cargo ignoruje wydanie 0.9.0.

Teraz zauważysz również zmianę w pliku Cargo.lock - wersja skrzyni rand będzie ustawiona na 0.8.6.

Gdybyś chciał używać rand w wersji 0.9.0 lub jakiejkolwiek z serii 0.9.x,

musiałbyś zaktualizować plik Cargo.toml do takiej postaci:

[dependencies]

rand = "0.9.0"

Następnym razem gdy wywołasz cargo build, Cargo zaktualizuje rejestr dostępnych skrzyń i

zastosuje nowe wymagania co do wersji skrzyni rand, zgodnie z tym co zamieściłeś w pliku.

Można by jeszcze wiele mówić o Cargo i jego ekosystemie. Wrócimy do tego w rozdziale 14. Na razie wiesz wszystko, co w tej chwili potrzebujesz. Dzięki Cargo ponowne używanie bibliotek jest bardzo łatwe, więc Rustowcy mogą pisać mniejsze projekty, składające się z wielu skrzyń.

Generowanie Losowej Liczby

A teraz użyjmy w końcu skrzyni rand by wygenerować liczbę do zgadnięcia.

Zmodyfikujmy plik src/main.rs, tak jak pokazano na listingu 2-3:

Plik: src/main.rs

use std::io;

use rand::Rng;

fn main() {

println!("Zgadnij liczbę!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("Sekretna liczba to: {secret_number}");

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

println!("Wybrana przez ciebie liczba: {guess}");

}Listing 2-3: Zmiany potrzebne do wygenerowania losowej liczby

Najpierw dodajmy linię use rand::Rng;. Rng to cecha (ang. trait), która definiuje metody implementowane przez generator liczb losowych. Cecha ta musi być widoczna w zasięgu, w którym chcemy tych metod używać.

Cechy szczegółowo omówimy w rozdziale 10.

Dodajemy również dwie linie w środku. W pierwszej linii wywołujemy funkcję rand::thread_rng, która daje nam gotowy do użycia konkretny generator liczb losowych:

taki, który jest lokalny dla wątku wywołującego i seedowany z systemu operacyjnego.

Następnie wywołujemy metodę gen_range tego generatora. Ta metoda zdefiniowana jest w cesze Rng,

którą włączyliśmy wyrażeniem use rand::Rng;.

Zakres typu start..=koniec jest inkluzywny, zawiera obie podane wartości granicznej, dolną i górną.

Dlatego podaliśmy 1..=100, aby zażądać liczby pomiędzy 1 a 100.

Uwaga: Wiedza, której cechy użyć i które funkcje i metody ze skrzyni wywoływać, nie jest czymś co po prostu wiesz. Instrukcja jak używać danej skrzyni znajduje się zawsze w jej dokumentacji. Kolejną przydatną komendą Cargo jest polecenie

cargo doc --open, które lokalnie zbuduje dokumentację dostarczaną przez wszystkie zależności, jakich używasz, i otworzy ją w przeglądarce. Gdyby, przykładowo, interesowały cię inne funkcjonalności ze skrzynirand, wpiszcargo doc --openi wybierzrandz paska po lewej.

Druga dodana przez nas linia wypisuje na ekranie sekretną liczbę. Jest to przydatne podczas implementowania do testowania programu i zostanie usunięte w finalnej wersji. Gra nie byłaby zbyt ekscytująca, gdyby program podawał sekretną liczbę od razu na starcie!

Spróbuj uruchomić program kilka razy:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 2.53 secs

Running `target/debug/guessing_game`

Zgadnij liczbę!

Sekretna liczba to: 7

Podaj swoją liczbę:

4

Wybrana przez ciebie liczba: 4

$ cargo run

Running `target/debug/guessing_game`

Zgadnij liczbę!

Sekretna liczba to: 83

Podaj swoją liczbę:

5

Wybrana przez ciebie liczba: 5

Za każdym razem powinieneś/powinnaś otrzymać inny sekretny numer, jednak zawsze z zakresu od 1 do 100. Dobra robota!

Porównywanie Odpowiedzi z Sekretnym Numerem

Teraz, kiedy już mamy odpowiedź gracza i wylosowaną sekretną liczbę, możemy je porównać. Ten krok przedstawiony jest na listingu 2-4. Ten kod nie będzie się jeszcze kompilował. Zaraz wyjaśnimy dlaczego.

Plik: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

// --snip--

println!("Zgadnij liczbę!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("Sekretna liczba to: {secret_number}");

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

println!("Wybrana przez ciebie liczba: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Za mała!"),

Ordering::Greater => println!("Za duża!"),

Ordering::Equal => println!("Jesteś zwycięzcą!"),

}

}Listing 2-4: Obsługa możliwych rezultatów operacji porównywania dwóch liczb

Po pierwsze dodaliśmy kolejne use, które wprowadza nam do zasięgu typ std::cmp::Ordering z biblioteki standardowej.

Ordering jest enumem, takim jak Result, ale ma inne warianty: Less, Greater, i Equal. Są to trzy możliwe wyniki porównywania dwóch wartości.

Następnie dopisaliśmy na końcu pięć nowych linii wykorzystujących typ Ordering.

Metoda cmp porównuje dwie wartości. Można wywołać ją na dowolnym obiekcie, który da się porównywać.

Przyjmuje ona referencję do drugiego obiektu, z którym chcemy porównać pierwszy:

tutaj porównujemy guess do secret_number. cmp zwraca wariant enuma Ordering

(którego typ zaciągnęliśmy poprzez wyrażenie use). Za pomocą wyrażenia match, na podstawie wartości Ordering zwróconej przez wywołanie cmp z wartościami guess z secret_number, decydujemy, co zrobić dalej.

Wyrażenie match składa się z odnóg. Każda odnoga składa się ze wzorca dopasowania i kodu, który ma się wykonać, jeśli wartość podana na początku wyrażenia match będzie pasowała do danego wzorca.

Rust bierze wartość podaną do match i przegląda kolejno wzorce ze wszystkich odnóg.

Wzorce i konstrukcja match to potężne mechanizmy w Ruście, które pozwolą wyrazić w kodzie wiele różnych scenariuszy i pomogą zapewnić obsługę ich wszystkich.

Zostaną one omówione szczegółowo, odpowiednio w rozdziale 6 i 18.

Przeanalizujmy na przykładzie, co dokładnie dzieje się z użytym tutaj wyrażeniem match.

Powiedzmy, że użytkownik wybrał liczbę 50, a losowo wygenerowana sekretna liczba to 38.

Kiedy kod porówna 50 do 38, metoda cmp zwróci wartość Ordering::Greater, ponieważ 50 jest większe niż 38.

Zatem match otrzymuje tutaj wartość Ordering::Greater.

Match sprawdza wzorzec w pierwszej odnodze, Ordering::Less, ale wartość Ordering::Greater nie pasuje do wzorca Ordering::Less, więc kod z tej odnogi jest pomijany i sprawdzana jest następna odnoga.

Wzorzec z następnej odnogi, Ordering::Greater, pasuje do Ordering::Greater!

Powiązany kod w tej odnodze jest wykonywany i na ekranie pojawia się napis Za duża!.

Wyrażenie match kończy wykonanie po pierwszym znalezionym dopasowaniu, więc ostatnia odnoga nie będzie już w tym przypadku sprawdzana.

Niemniej, kod z listingu 2-4 jeszcze się nie skompiluje. Spróbujmy:

$ cargo build

Compiling libc v0.2.86

Compiling getrandom v0.2.2

Compiling cfg-if v1.0.0

Compiling ppv-lite86 v0.2.10

Compiling rand_core v0.6.2

Compiling rand_chacha v0.3.0

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

error[E0308]: mismatched types

--> src/main.rs:22:21

|

22 | match guess.cmp(&secret_number) {

| --- ^^^^^^^^^^^^^^ expected struct `String`, found integer

| |

| arguments to this function are incorrect

|

= note: expected reference `&String`

found reference `&{integer}`

note: associated function defined here

--> /rustc/d5a82bbd26e1ad8b7401f6a718a9c57c96905483/library/core/src/cmp.rs:783:8

For more information about this error, try `rustc --explain E0308`.

error: could not compile `guessing_game` due to previous error

Komunikat błędu wskazuje, że typy są niezgodne. Rust jest silnie statycznym typowanym językiem. Jednak również wspiera dedukcję typów.

Kiedy napisaliśmy let guess = String::new(), Rust potrafił wywnioskować, że guess powinno być Stringiem,

dzięki czemu nie musieliśmy pisać typu jawnie.

Z drugiej strony, secret_number jest typem numerycznym. Wiele typów numerycznych może przyjmować wartość spomiędzy 1 a 100:

i32, 32-bitowa liczba całkowita; u32, 32-bitowa liczba całkowita bez znaku; i64, 64-bitowa liczba całkowita; a także inne.

Jeśli nie wskazano inaczej, to domyślnie Rust wybiera i32, co jest typem secret_number, jeśli nie wpisaliśmy gdzieś indziej w kodzie jakiejś informacji,

która spowoduje że Rust wybierze inny typ. Przyczyną błędu jest to, że Rust nie potrafi porównywać

stringa z typem numerycznym.

Ostatecznie musimy przekonwertować stringa, którego program wczytał jako wejście z klawiatury,

do postaci typu numerycznego, który można porównać matematycznie do sekretnej liczby. Osiągamy to dodając kolejną linię do ciała funkcji main:

Plik: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

println!("Zgadnij liczbę!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("Sekretna liczba to: {secret_number}");

println!("Podaj swoją liczbę:");

// --snip--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

let guess: u32 = guess.trim().parse().expect("Podaj liczbę!");

println!("Wybrana przez ciebie liczba: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Za mała!"),

Ordering::Greater => println!("Za duża!"),

Ordering::Equal => println!("Jesteś zwycięzcą!"),

}

}Dodana linia to:

let guess: u32 = guess.trim().parse().expect("Podaj liczbę!");Tworzymy tu zmienną o nazwie guess. Ale czekaj, czy program przypadkiem nie ma już zmiennej o takiej nazwie? Owszem ma, ale szczęśliwie Rust pozwala przesłaniać poprzednią wartość

zmiennej guess nową wartością. Przesłanianie (shadowing)

pozwala użyć ponownie nazwy guess, zamiast zmuszać nas do tworzenia dwóch osobnych zmiennych, takich jak przykładowo guess_str i guess. Rozdział 3 opowiada więcej o przesłanianiu zmiennych. Teraz wspomnimy jedynie, że funkcjonalność ta jest często używana w sytuacjach, gdy konieczna jest konwersja wartości z jednego typu do drugiego.

Nowej zmiennej guess nadajemy wartość wyrażenia guess.trim().parse(). Zmienna guess w tym wyrażeniu

odnosi się do pierwotnej zmiennej guess, która była stringiem zawierającym dane wczytane z klawiatury.

Metoda trim z interfejsu Stringa spowoduje usunięcie wszelkich białych znaków znajdujących

się na początku lub końcu stringa. Jest to niezbędne, bo aby sparsować String do typu u32, String ten powinien zawierać jedynie znaki numeryczne.

Jednakże, aby zadowolić funkcję read_line, użytkownik musi

wcisnąć enter. Po wciśnięciu enter znak nowej linii jest dopisywany do stringa. Przykładowo, jeśli użytkownik wpisał 5 i wcisnął enter, to guess przyjmie postać: 5\n.

Znak \n reprezentuje nową linię, czyli wynik wciśnięcia enter. (Pod Windowsem w wyniku wciśnięcia enter otrzymujemy \r\n.)

Metoda trim usunie niechciane \n, dzięki czemu w stringu pozostanie jedynie 5.

Metoda parse parsuje stringa do innego typu. Tu używamy jej by otrzymać typ liczbowy. Co więcej, musimy powiedzieć Rustowi, jakiego dokładnie typu oczekujemy, używając wyrażenia let guess: u32.

Dwukropek (:) po guess informuje Rusta, że dalej podany będzie typ zmiennej.

Rust ma kilka wbudowanych typów numerycznych;

u32, którą tu podaliśmy, to 32-bitowa liczba całkowita bez znaku. Jest to dobry domyślny wybór dla małych liczb dodatnich.

O innych typach numerycznych przeczytasz w rozdziale 3.

Dodatkowo, dzięki anotacji u32 w tym przykładowym programie

i porównaniu tej liczby z secret_number, Rust wywnioskuje, że secret_number też powinien być typu u32. Zatem

porównanie zachodzi pomiędzy dwiema wartościami tego samego typu!

Wywołanie parse często może zakończyć się niepowodzeniem. Jeśli, na przykład, string będzie zawierał

A👍%, to jego konwersja do liczby nie może się udać. Z tego względu metoda parse zwraca

typ Result, podobnie jak metoda read_line (wspominaliśmy o tym wcześniej w sekcji

„Obsługa potencjalnych błędów z użyciem Result”). Potraktujemy ten Result w ten sam sposób, używając ponownie metody expect. Jeśli parse zwróci wariant Err

(ponieważ nie udało się stworzyć liczby ze stringa), wywołanie expect spowoduje zawieszenie się gry i wypisanie na ekran

podanego przez nas tekstu. Gdy zaś parse powiedzie się i poprawnie skonwertuje stringa do liczby, zwrócony Result

będzie wariantem Ok, a expect zwróci liczbę zaszytą w wartości Ok.

Teraz uruchomimy program!

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 0.43 secs

Running `target/debug/guessing_game`

Zgadnij liczbę!

Sekretna liczba to: 58

Podaj swoją liczbę:

76

Wybrana przez ciebie liczba: 76

Za duża!

Nieźle! Pomimo tego że dodaliśmy spacje przed liczbą, program wciąż poprawnie rozpoznał, że użytkownik wybrał liczbę 76. Uruchom program kilka razy, aby sprawdzić jak program reaguje na różne wejścia: podaj właściwą liczbę, za wysoką, następnie za niską.

Nasza gra już z grubsza działa, ale użytkownik może odgadywać liczbę tylko jeden raz. Zmieńmy to dodając pętlę!

Wielokrotne zgadywanie dzięki pętli

Słowo kluczowe loop (pętla) tworzy pętlę nieskończoną. Dodamy taką pętlę, żeby dać graczowi więcej szans na odgadnięcie liczby:

Plik: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

println!("Zgadnij liczbę!");

let secret_number = rand::thread_rng().gen_range(1..=100);

// --snip--

println!("Sekretna liczba to: {secret_number}");

loop {

println!("Podaj swoją liczbę:");

// --snip--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

let guess: u32 = guess.trim().parse().expect("Podaj liczbę!");

println!("Wybrana przez ciebie liczba: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Za mała!"),

Ordering::Greater => println!("Za duża!"),

Ordering::Equal => println!("Jesteś zwycięzcą!"),

}

}

}Jak widzisz, przenieśliśmy do pętli cały kod następujący po zachęcie gracza do odgadnięcia liczby. Pamiętaj, żeby zwiększyć wcięcia linii wewnątrz pętli o kolejne cztery spacje, następnie uruchom program ponownie. Niestety teraz program pyta o wprowadzenie odgadniętej liczby w nieskończoność i użytkownik nie może z niego łatwo wyjść!

Użytkownik może zawsze zatrzymać program używając skrótu klawiszowego ctrl-c. Lecz

jest jeszcze inny sposób, żeby uciec temu nienasyconemu potworowi, jak wspomnieliśmy w dyskusji o parse

w „Porównywanie odpowiedzi gracza z sekretnym numerem”: wprowadzenie znaku, który nie jest liczbą, spowoduje zawieszenie się programu. Można z tego skorzystać,

aby wyjść z programu, tak jak pokazujemy poniżej:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 1.50 secs

Running `target/debug/guessing_game`

Zgadnij liczbę!

Sekretna liczba to: 59

Podaj swoją liczbę:

45

Wybrana przez ciebie liczba: 45

Za mała!

Podaj swoją liczbę:

60

Wybrana przez ciebie liczba: 60

Za duża!

Podaj swoją liczbę:

59

Wybrana przez ciebie liczba: 59

Jesteś zwycięzcą!

Podaj swoją liczbę:

quit

thread 'main' panicked at 'Podaj liczbę!: ParseIntError { kind: InvalidDigit }', src/main.rs:28:47

note: run with `RUST_BACKTRACE=1` environment variable to display a backtrace

Wpisanie quit faktycznie powoduje wyjście z programu, ale taki sam skutek daje wprowadzenie dowolnego innego ciągu znaków nienumerycznych. Zamykanie programu w ten sposób nie jest zbyt optymalne. Dodatkowo, chcielibyśmy, aby gra zatrzymała się, kiedy gracz wprowadzi poprawny numer.

Wychodzenie z programu po poprawnym odgadnięciu

Dodanie wyrażenia break sprawi, że gra zakończy się, kiedy gracz wygra.

Plik: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

println!("Zgadnij liczbę!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("Sekretna liczba to: {secret_number}");

loop {

println!("Podaj swoją liczbę:");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Błąd wczytania linii");

let guess: u32 = guess.trim().parse().expect("Podaj liczbę!");

println!("Wybrana przez ciebie liczba: {guess}");

// --snip--

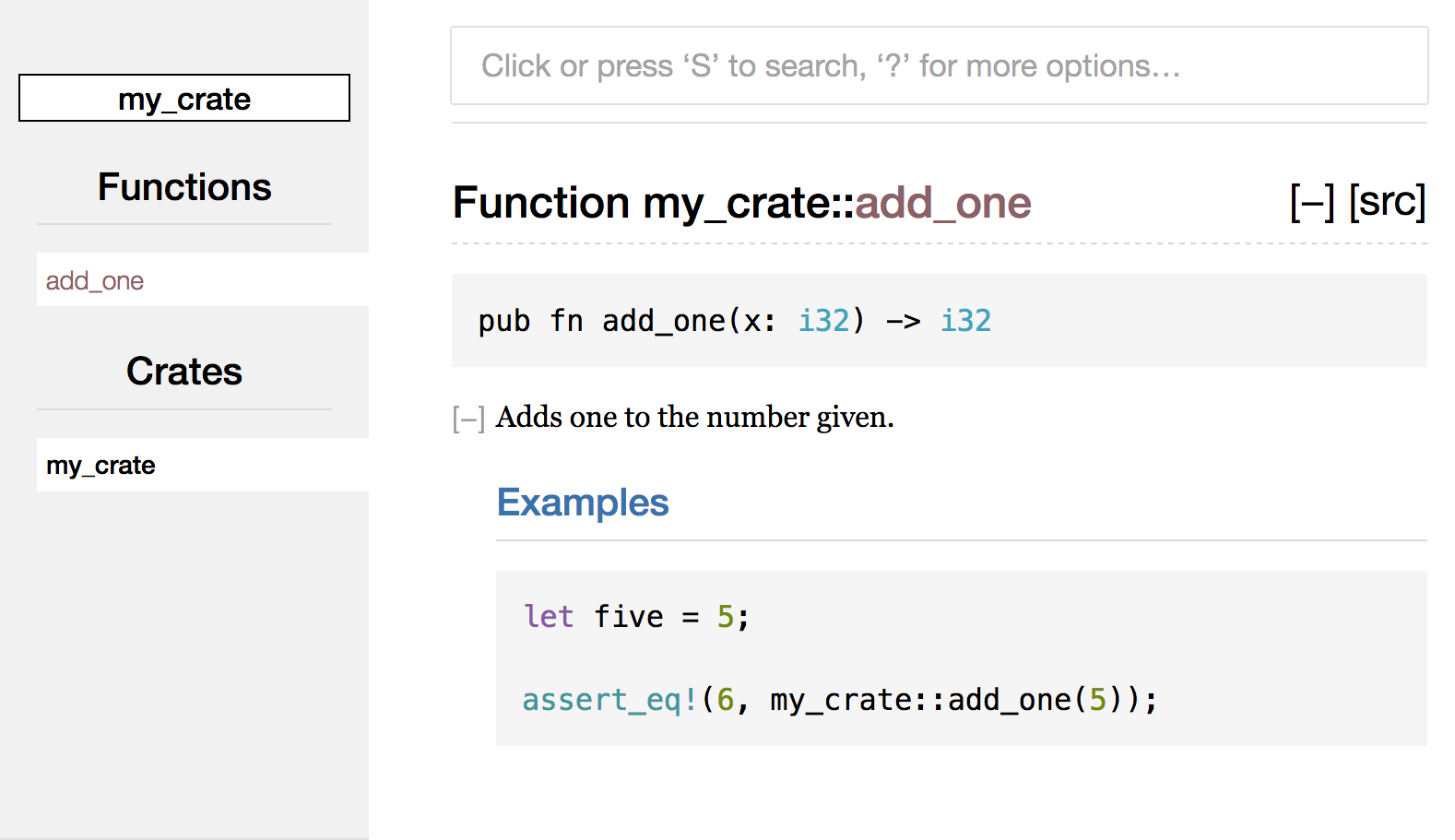

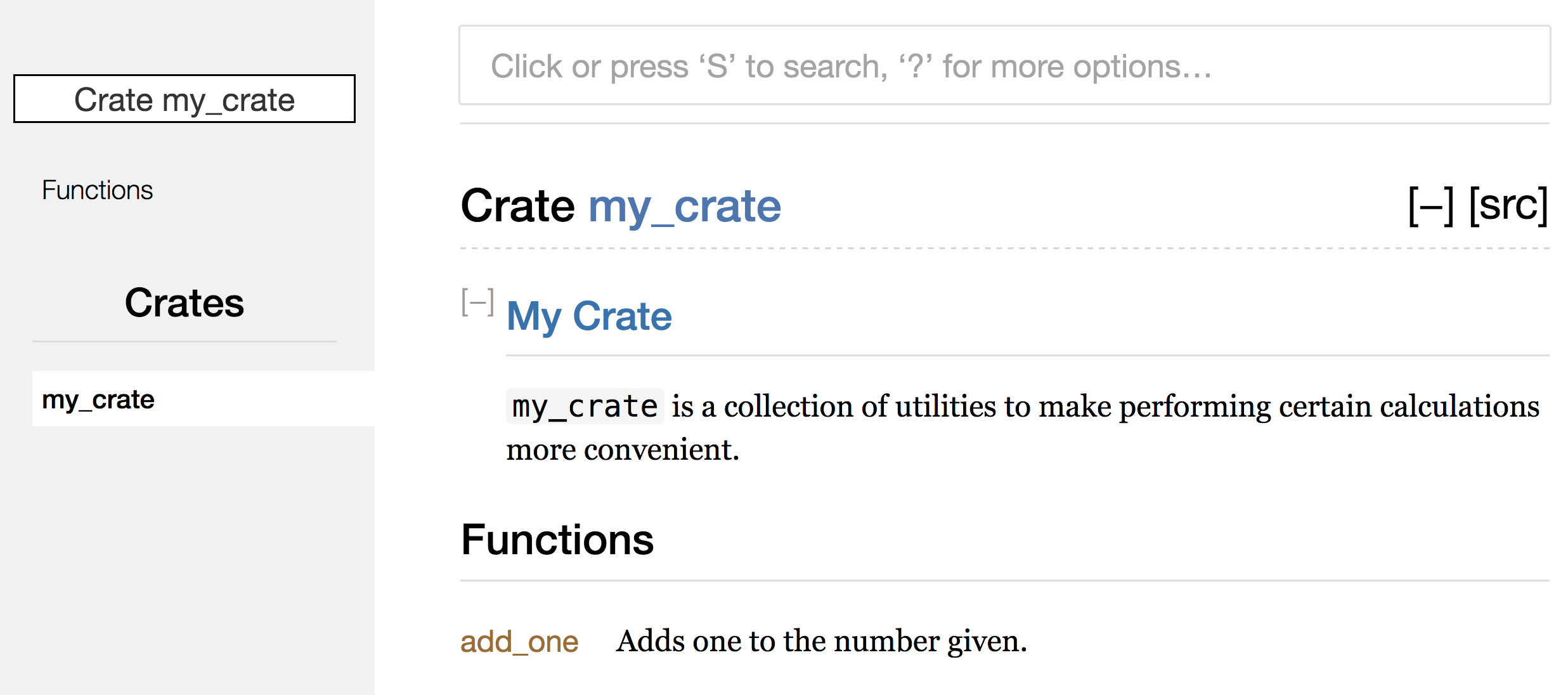

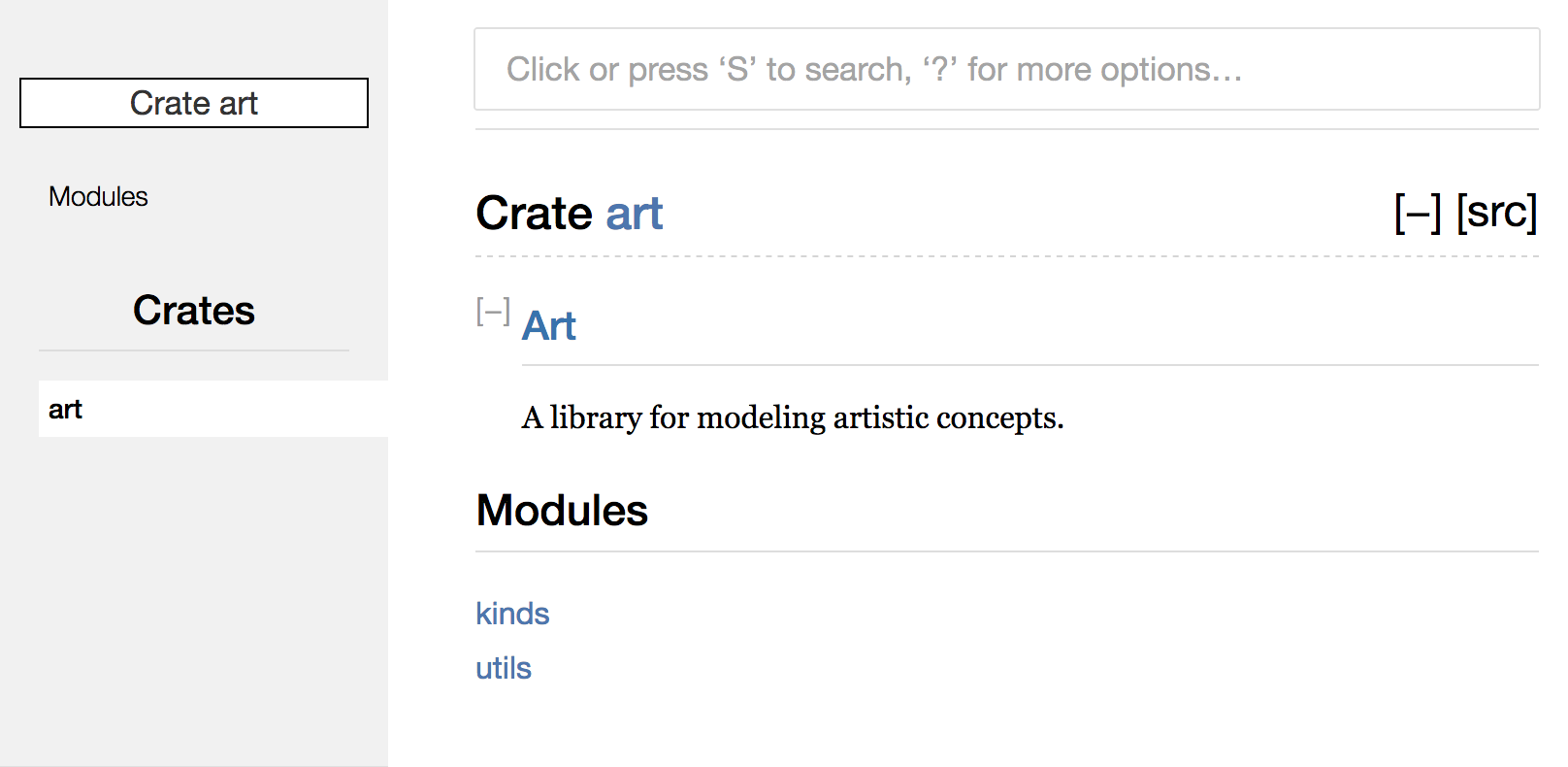

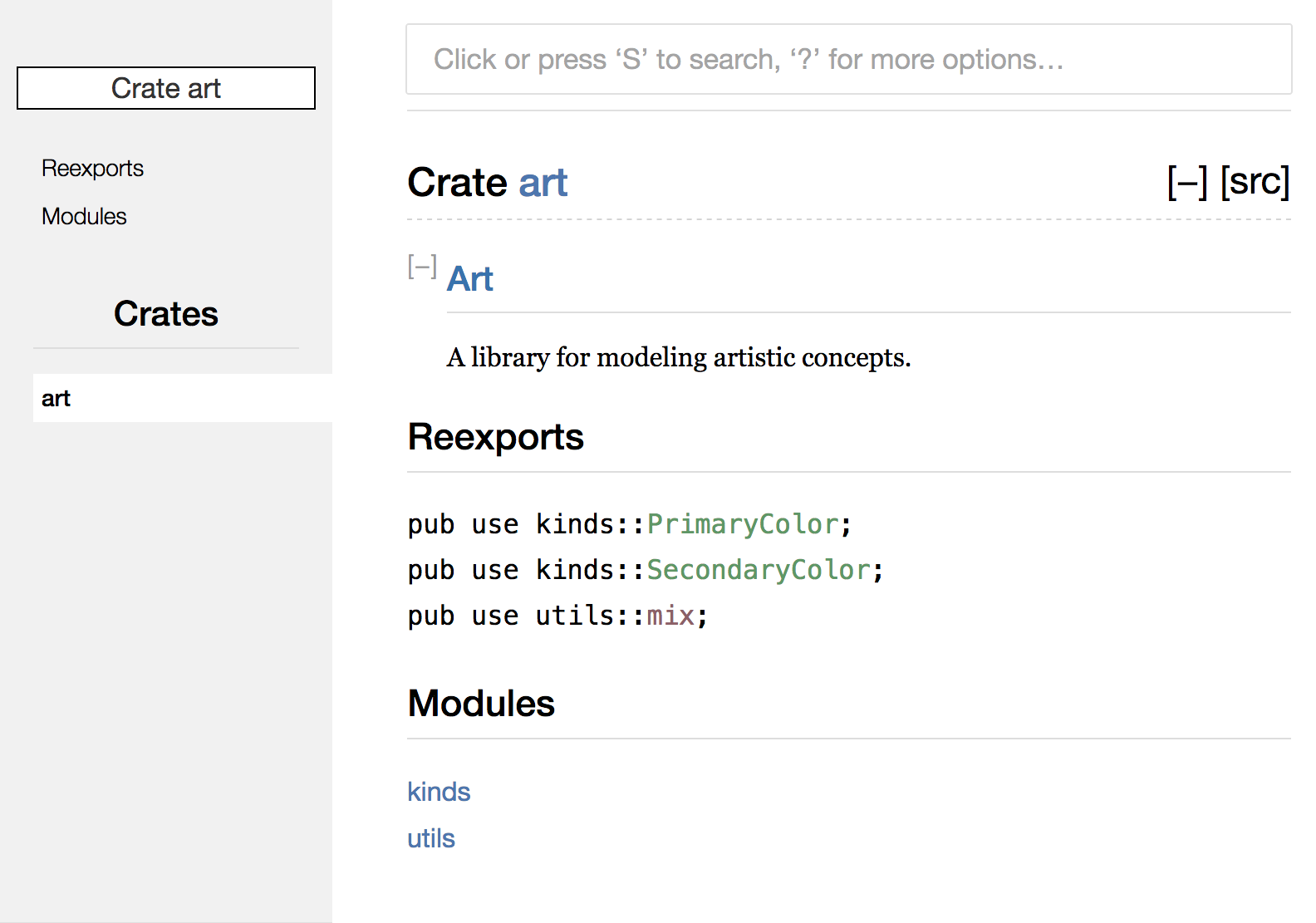

match guess.cmp(&secret_number) {